A Sony bejelentette az új APS-C kamerájával egyidejűleg, hogy új AF-algoritmust fejlesztett, melyet nem csak a most bemutatott A6400 kamera kap meg, hanem visszamenőleg beleteszik az A7/A9 széria aktuális generációjába is. Ebben pedig már szerepet kap a mesterséges intelligencia, ha jól sejtem elsőként a fotográfia világában.

A tavalyi Photokinán a Sony nem durrantott nagyot, csak egy sajtótájékoztatót tartottak, melyben elmesélték, hogy 12 új E-mount optikát fognak piacra dobni a közeljövőben, illetve azt, hogy kísérleteznek a mesterséges intelligenca felhasználásával az autofókusz működése során, továbbá azt is elmondták, hogy az Eye-AF működni fog állatokkal is.

Mindössze 4 hónapot kellett várni erre, a most bemutatott Sony A6400 mirrorless kamerában már megjelent az új technológia, firmware frissítésben pedig megkapja az új fícsöröket az A9, az A7R III és az A7 III is.

Elősször lássuk miről van szó:

A Sony A6400 promovideójában is láthatjuk az AI-powered Eye-AF funkciót:

Az új gép egyébként barátságos áron érkezik, de most nem erről szeretnék beszélni. Hanem arról, hogy a követés, az arcfelismerés és az eye-af egy új szintre lépett, és nem csak azért mert gyorsabb lesz és bizonyára kifinomultabb az AI által, hanem azért, mert korábban az Eye-AF-et gombra kellett programozni, most viszont úgy tűnik, a kamera követőfókusz módban automatikusan, és nagyjából késlekedés nélkül lesz képes váltogatni a sima követő AF, az arckövető AF és az Eye-AF között. Ez az alábbi DPReview videóban nagyon jól látszik (3:27-től kb.):

A fentieken kívül – ha jól értettem a Dpreview videóból -, végre úgy működik a követőfókusz, mint egy DSLR-ben, vagyis ha single vagy extended fókuszponttal mutatjuk meg a témát a kamerának, azt nem csak a kis kereten belül követi a mozgó témát (és veszíti el ha kilép a keretből), hanem bárhová megy utána a teljes fókuszmezőben. Ezt eddig csak Center AF ponttal tudta a Sony, meg létezett Center Lock-On AF is, de valljuk be ezek kissé bonyolultak voltak egy DSLR-megoldáshoz képest. Most azonban leegyszerűsítették a dolgot és úgy működik…hát….szóval ahogy eddig is kellett volna. Megmutatjuk a témát, majd a kamera követi bárhová a fókuszterületen és automatikusan váltogat egyszerű tracking, face-detect és eye-af között. Halleluja!

A bónusz meg persze az, hogy állatokkal is működni fog az Eye-AF, ami természetfotósoknak nagy áldás lesz, ha tényleg hatékony. Hogy egy madárral is működni fog-e röptében, azzal azért fenntartásaim vannak (persze ki tudja?), de emlősállatokkal szerintem nem lesz nagy gond.

Lássuk mely masinák mindebből mit kapnak meg?

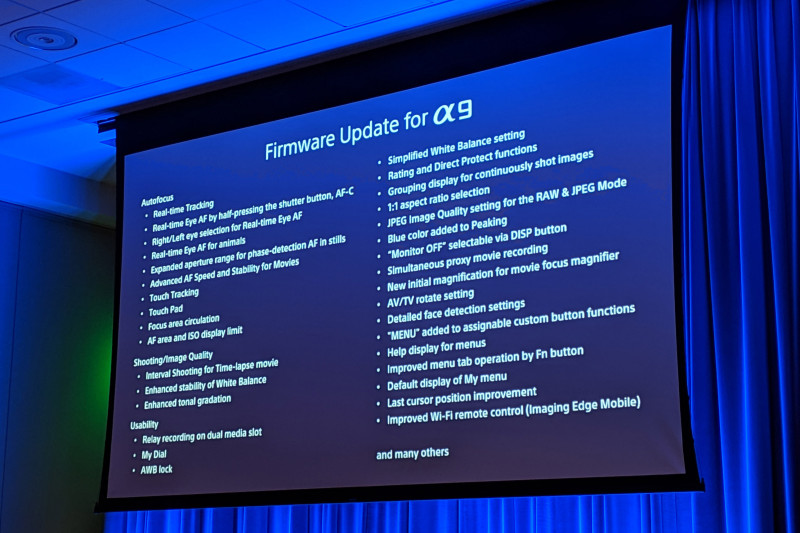

Az A9 frissítése két lépésben érkezik. Az 5.0 jön márciusban, a 6.0 pedig a nyár folyamán. Előbbi verzió tartalmazza majd a Real-Time Tracking üzemmódot, ami a Sony új témafelismerő, mesterséges intelligencia alapú algoritmusa. Az új algoritmus vigyelembe veszi emberek esetén a szemeket, az arcot, továbbá a téma színét és távolságát. Ha megmutatjuk a témánkat a kamerának, az előnyben részesíti a szemeket a követésnél, ha elveszíti a szemet, akkor az arcot priorizálja, ha azt is elveszíti akkor is rajta marad a témán (pl. ha elfordul az alanyunk). A korábbi verzióknál ilyenkor előfordult hogy több ember esetén átugrott a fókusz egy másik arcra. A Sony A9-ben az autofókusznak saját processzora van, bizonyára ez teszi lehetővé az új algoritmus által igényelt plusz számítási kapacitást. Mivel a többi Alpha kamerában nincs ilyen, ezért azok nem kapják meg a Real-Time Trackinget. Az A9-be jön még a Touch Tracking és Touch Pad funkció, valamiféle Focus area circulation, továbbá Time Lapse, videó esetén stabilabb White Balance és Relay Recording (ha az egyik kártya betelik, folytatja a másikon) és még egy csomó apróság, ami ha jól látom az új A7-ekben megvan, de az A9-ből még kimaradt. Érdekesség, hogy a kamera színreprodukciójába, tónusátmenetek kezelésébe, és az Auto-WB algoritumusába is belenyúlnak az új 5.0 firmware-rel, a Sony szerint ezáltal javulni fog a képminőség. Jön valamiféle My Dial funkció is.

Aztán van még ugye a Real-Time Eye-AF, vagyis az a funkció, ami úgy követi a modell szemét, hogy nem kell ehhez egy külön gombot nyomva tartani, továbbá előre megadhatjuk, hogy a témánk jobb, bal vagy a közelebbi szemét szeretnénk-e élesnek látni. Ez a funkció bekerül az A9-be, az A7R III-ba és az A7 III-ba is, a hírek szerint március-áprilisban érkezik.

A harmadik funkció az állatok esetében is működő Eye-AF. Ez is mesterséges intelligenciát használ, szóval sajnos csak az A9 kapja meg az új funkciót, ezt is csak a 6.0-ás firmware-rel, ami nyáron érkezik. Update: ezt a funkciót megkapja a többi kamera is!

A Time-Lapse funkciót megkapja az A7-széria III generációja is.

Az időzítés tehát úgy néz ki, hogy 1. A9 frissítés márciusban, A7 frissítés áprilisban, 2. A9 frissítés nyáron.

Azt hiszem a Sony jól időzítette a bejelentést, tekintve, hogy a Canon és a Nikon annyira nyomja a marketinget a mirrorlesseinek, hogy biztos vagyok benne, az elmúlt hónapokban néhány frissen átpártolt Sonys már kezdett meginogni, gondolván, hogy lehet mégiscsak vissza kellene térni a gyökerekhez. A Sony aztáltal, hogy elsőként a piaconolyan high-end technológiát vitt a gépeibe, mint a mesterséges intelligencia, ismét bebizonyította, hogy innováció terén továbbra is lépéselőnyben van a nagyokhoz képest.

Már csak egy dolgot nem értek…

Ha a maximum középkategóriásnak nevezhető APS-C kamerába, az új A6400-ba belefért az AI, akkor a fullframe szegmensben miért csak az A9 kapja meg…? Lehet, hogy mégsem a plusz processzoron múlik ez, hanem szimplán csak marketing? Elég jó esély van rá szerintem, hogy az A7R IV és az A7 IV már tudni fogja ezt. Jóllehet a Sony figyelmeztet a promovideóiban, hogy az új funkciók működése nagyban múlik a kameramodellen és szituációkon, ergo bizonyára egy A9-ben az AI követés “kicsit” jobb lesz, mint az A6400-ban.

Update: Egyedül a témafelismerő Real-Time Tracking az amit csak az A9 fog tudni, a többi funkciót megkapja minden gép. Mind a Real-Time Eye-AF, mind pedig az Animal Eye-AF mesterséges intelligencia technológiát használ a működéshez, vagyis az AI nem csak az A9 kiváltsága.